2025-07-17

分享到

拒止环境下的自主导航是未来无人机在各领域应对复杂环境时务必要解决的首要问题。目前,无人机导航和定位主要依赖全球卫星导航系统(GNSS)和惯性导航系统(INS),GNSS具有高精度特点,但容易受到外部复杂环境干扰;INS抗干扰能力较强,但其定位误差会随时间慢慢累积。景象匹配导航技术(SMN)具有长时自主性、可视性、高精度、抗干扰性强、智能化等优点,更适合拒止环境下作为辅助GNSS和INS的自主导航手段为无人机飞行提供服务。该文聚焦无人机景象匹配导航技术系统原理,介绍了无人机景象匹配导航关键技术组成,并对该领域近十年的发展现状进行了梳理总结,最后对无人机景象匹配导航技术未来发展趋势进行了展望。

无人机拍摄的图像信息处理、分析和识别技术已广泛应用于搜索救援、工业巡检、地形测绘、精准农业、生态环境监测以及野生动物保护等多个领域。这些技术的发展不仅推动了图像处理、计算机视觉和模式识别等学科的快速进步,也使其成为研究的前沿。然而,要实现基于无人机平台的任务执行,首先需要解决的是其高精度的定位与导航问题。

1、GNSS 以其高精度而著称,但在复杂环境中可能因电磁干扰或信号服务中断而失效。

2、惯性导航系统( INS )具有自主性,不依赖外部信息,且短时间内精度高,但存在随时间累积的误差问题。

3、无线电导航通过发射和接收电磁波来确定飞机的相对位置,也容易受到干扰。

4、航程推算 则利用无人机的传感器数据和风速信息来实时计算位置,但其准确性受限于传感器和风速测量的精度,且误差随时间增长。

为了提高无人机的导航可靠性,需要综合运用这些技术,并探索新的解决方案以应对各种挑战。

基于图像传感器的视觉定位和导航技术不仅能够达到与GNSS相当的精度,还能在GNSS信号受到干扰或不可用时提供替代方案,从而降低无人机平台的成本,具有重要的实际意义。然而,视觉里程计和SLAM技术在没有外部校正和闭环优化的情况下,其误差会逐渐累积,限制了它们在独立环境下实现全局域导航的能力。相比之下,景象匹配导航技术则可以有效避免这一问题,提供了一种更为可靠的导航解决方案。

景象匹配导航技术起源于巡航导弹末端制导,具有设备结构简单、抗干扰、定位精度高等特点。其事先利用侦察手段获取飞行器任务规划区域的地物图像作为基准图像预存于机载设备中;然后实际飞行时通过自身携带的传感器获取当地图像,参考图像分辨率、相机视场角和飞行高度等参数进行一定的预处理并与基准图像进行检索查询和匹配;由于基准图像的地理坐标位置是精确已知的,一旦完成正确匹配即可确定飞行器的绝对位置,可以作为一种辅助GNSS和INS的技术手段为导弹末端识别定位打击目标提供服务。整个过程中采用的查询图像和基准图像之间差异不大,匹配定位算法多使用模板匹配。而无人机平台则一般使用卫星遥感图像作为基准图像,卫星遥感图像具有覆盖范围广、容易获得,但其制作周期较长,因此基准图像和查询图像之间存在着不同时间、不同季节、不同光照、不同传感器、不同高度的差异,对匹配算法提出了更高的要求,国内外的研究也纷纷针对异源匹配这一关键技术展开的。

图1展示了无人机景象匹配导航技术系统框架,可以看出其核心在于图像匹配算法,其性能的优劣直接决定了整个导航系统的效能。

基准图像是无人机预定飞行轨迹上带有精确地理定位信息的图像,通常来源于高分辨率卫星光学/红外图像、合成孔径雷达图像(Synthetic aperture radar, SAR)、无人机航拍图像等。基准图像的制备是景象匹配定位导航实现的基础,对于提高匹配概率和精度具有重要意义,主要包括图像的预处理和适配区选取[17]。图像的预处理是对所获取的图像通过几何校正、灰度校正、滤波去噪等方法进行处理得到投影误差较少的数字图像,一般采用数字正射图像Digital orthophoto map, DOM)作为基准图像。适配区选取是从一幅较大的图像中依据一定的评价准则选取具有较高的匹配概率和匹配精度且具有特定尺寸的区域作为导航基准图像。

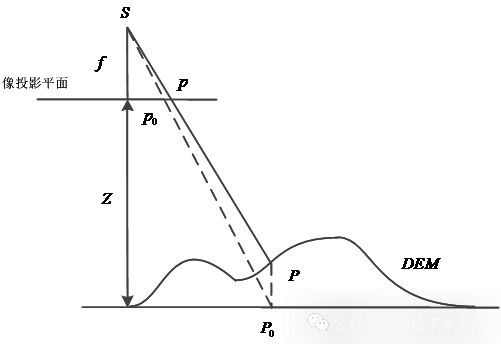

由航拍得到的地面图像受到平台倾斜和地形起伏影响,其与 DOM 间可能存在较大差异,需要采用共线方程模型、多项式变换模型、放射变换、透视变换等进行几何校正 [18] ,在高程已知的情况下,共线方程模型更适合地形起伏较大的情况。

雷达图像则是需要根据传感器的轨道参数和成像参数按照一定的散射模型模拟出来,可分为以特征为基础和以信号为基础的模拟图像[19],适合光照不好条件下的景象匹配制导。不论是光学图像、红外图像还是SAR图像,都属于栅格图像的范畴,随着工业水平的进步,栅格图像的清晰度越来越高,这也会导致其数据量需要更大的存储空间。针对此类问题,国内外有关学者纷纷尝试利用数据量更小的矢量地图代替栅格图像制备基准图像[20][21]。如文献[22]将航空图像中目标特征如道路、河流、道路交叉口、村庄、桥梁等提取出来并加工处理为与地理信息系统(Geographic information system, GIS)数据表示一致的几何点和几何向量,然后与GIS模型配准实现定位,降低了基准图像对存储空间的要求。文献[23]通过识别航空图像中的道路和路口等语义特征与开放街道地图(OpenStreetMap, OSM)项目中收集的地图矢量道路数据进行匹配定位,取得了较高精度的定位结果。文献[24]根据景象匹配导航需求结合矢量数据结构的特点,提出了一种航拍图像矢量化的方法,选定水域目标提取边缘轮廓,采用基于特殊点跟踪的矢量化算法实现了所有轮廓曲线的矢量化,最后结合曲线差角特征不变性实现了矢量地图匹配定位。

1972年,Johnson[25]首次提出了景象匹配区选择的概念、理论和方法,是从较大图幅中选取匹配性能高且稳定的特定尺寸大小的区域作为基准图像,为后续航迹规划提供依据。通过相关文献分析,发现国内外对景象适配性研究存在不同的侧重点[26]。虽然此领域的适配性选取问题最初是由国外研究学生提出,但是直接针对这个问题做出大量系统研究的却是国内的相关机构,并且近十年来发表的景象匹配性的国内文献依然延续着这一思路;相对而言,国外研究主要集中在目标跟踪背景下的特定兴趣区域(Region of Interest, ROI)的特征提取和特征选择[27],而关于组合导航定位背景下的ROI选择的文献非常有限。

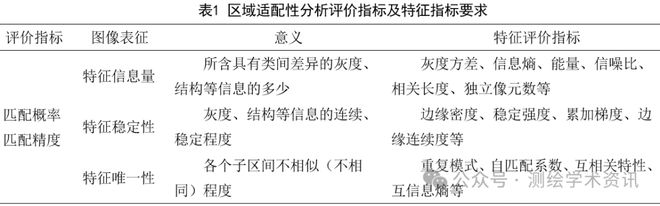

基准区域图像应能够被正确匹配到,即具有较高的匹配概率;同时实时图像与基准图中对应的区域图像对应位置点在一定的允许误差范围内,即具有较高的匹配精度。为了完成适配性分析,通常做法是依据一定的评价准则,采用相关的评价指标进行分析。常见的评价指标及特征指标要求见表1。

文献[28-29]基于支持向量机(Support vector machine, SVM)回归作为匹配概率的预测模型,对景象区域的预测概率进行阈值分割,最终获取该区域的适配性;与传统方法相比,具有更高的准确性,但其复杂度偏高,运算量较大,在制导应用中的实时性能难以保证。文献[30]根据基准图的适配性要求,提出了基于信息熵的景象匹配区域选取方法,分别以改进的图像信息熵、Frieden灰度熵和归一化平均互信息作为特征指标,以此为依据采取分层策略选取基准图,取得了较好的匹配概率和匹配精度。文献[31]基于边缘方向离散度实现了景象适配区自动选择方法,图像中的边缘方向分布可以描述特征纹理方向的分布范围情况,与区域适配性存在一定的正相关性。文献[32]将卷积神经网络(Convolutional neural networks, CNN)应用于SAR图像适配性分析,先将卫星从不同角度、不同相位拍摄的同一地块的SAR图像进行匹配,然后根据匹配结果自动标记出图像的匹配适宜性作为网络输出;接着将反映高程信息的数字高程模型数据与SAR图像灰度信息融合作为网络的输入;最后,利用CNN自动提取匹配特征,对SAR图像的适用性进行分类,与支持向量机方法相比,该方法的分类准确率从86.1%提高到93.3%。

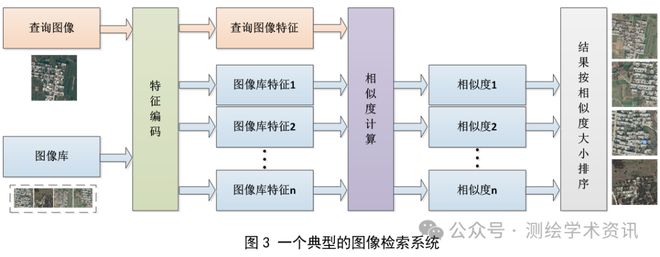

如何利用无人机实时图像高效检索适配区域基准图像是当前实际应用中最为核心的问题。与惯性导航的组合系统可利用惯导初始位置信息大致计算出相关图像候选对象范围,采用图像检索算法进行检索;而无先验位置信息状态时,需要从海量基准图像库中进行检索,检索的精度和时间消耗是重要技术指标。

基于图像内容的检索[33](Content-based image retrieval, CBIR)技术近些年在国内外均取得了快速的发展,并取得了不错的效果,为解决上述问题提供了思路。CBIR技术一般分为四个部分:提取视觉特征、视觉特征编码、构建索引结构和设计检索算法等。其中视觉特征可以传统的人工特征,如SIFT特征,也可以是更高层次语义的深度特征,如SuperPoint、DELF[34]等,然后通过局部特征聚合的方式得到图像的全局表达。常用的聚合方法有词袋模型[35](Bag of words, BoW)、局部聚合描述算法[36](Vector of locally aggregated descriptors, VLAD)、费舍尔矢量[37](Fisher vector, FV)等。以上聚合方法虽然在一定程度上提高了检索精度,但面对无人机和卫星遥感图像这样存在不同光照、各种语义对象、相似区域等情况不是特别的适应,如BoW的大规模码本问题,VLAD的硬分配问题,FV复杂计算量问题。因此,还需寻找一种更加鲁棒高效的检索方法以适应无人机景象匹配导航中的问题。

图像匹配是指通过空间变换,将一幅图像映射到同一场景的另一幅或多幅图像中,在两幅图像或多幅图像之间建立空间对应关系的过程[38]。景象匹配导航技术中,基准图像一般为通过遥感卫星获取某一时期的光学图像/红外图像/SAR图像等,查询图像为无人机后期任务飞行时依靠自身携带的视觉传感器实时获得的,二者之间存在时间、视角、光照、分辨率、传感器等方面的不同,这就导致同一地区的成像存在较大差异,为正确匹配增加了难度。

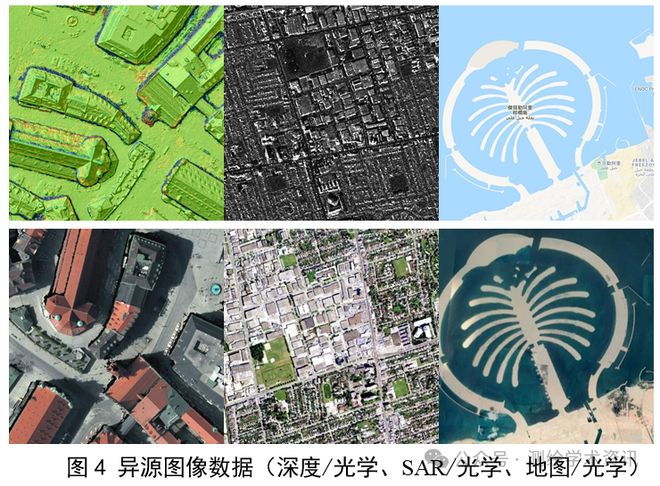

如图4所示,异源图像受成像机理、波段、时相等影响,在灰度特征、几何特征上都存在着巨大的差异[40],导致图像特征异构,无法准确定义和描述同名点,传统以梯度特征为基础的匹配算法不能较好地适应异源情况,难以实现可靠的匹配。针对此问题,专家学者纷纷开展深入的研究,提出了很多解决异源问题的方法,主要分三个方面:基于模板的匹配方法、基于显著特征的匹配方法、基于深度学习的匹配方法。

模板匹配是计算机视觉领域中常用的一种图像处理方法,它确定目标图像中与模板图像最接近的匹配区域。具体包括以下三个步骤:(1)设计搜索策略,确定所有模板图像对应的候选匹配窗口区域;(2)在设计的特征描述图上选择对应窗口区域的特征向量;(3)利用设计的相似度度量计算模板窗口与候选窗口特征向量之间的相似度。得分最高的候选匹配区域视为最终候选匹配窗口。以往常用的相似性度量有互信息、相位一致性及归一化互相关等[41],这些相似性度量计算复杂量较大,有些是以图像灰度信息进行计算,无法解决非线性辐射差异问题,不适用无人机景象匹配导航场景。文献[42]在模板匹配原理基础上,利用Log-Gabor滤波特征构建特征金字塔,采用由粗到细的密集匹配框架提取高精度匹配点对;为提高效率,提出像素重组方法,简化滑窗操作为单次矩阵乘法,大幅提升匹配速度,在一定程度上解决了非线性辐射差异问题。

基于显著特征匹配的方法采用人工特征,一般包括特征点提取、特征点描述、特征点匹配3个步骤。提取的特征应该具有鲁棒性、稳定性和可重复性,可以是点、线、面特征。在解决非线性辐射差异大的影响方面,相位一致性模型被引入了特征点描述符的构建,从频率域的角度出发对图像特征进行处理。如文献[43]提出借助梯度直方图结构模板,利用相位一致性特征值和特征方向,建立一种局部特征描述符—局部相位一致性方向直方图(Local histogram of orientated phase congruency,LHOPC),能够有效抵抗异源图像间的辐射差异,提高匹配性能;文献[39]提出的辐射不变特征(Radiation-variation Insensitive Feature,RIFT)在相位一致性特征图的基础上,通过建立最大映射索引图,编码描述特征算子进行匹配,对解决辐射差异方面也取得了不错的效果;文献[44]首先在相位特征处理方面采用相位一致性最大矩和最小矩特征作为待提取特征,结合对数极坐标模板设计了一种绝对相位方向提取直方图(Histogram of absolute phase consistency gradients,HAPCG),在一定程度上解决了光照差异、对比度大的问题;文献[45]提出了位置-方向-尺度引导的几何和强度不变特征变换(Position-orientation-scale guided geometric and intensity-invariant feature transformation,POS-GIFT)依据仿生学原理设计了一种多层圆形点采样模式有效捕获相位一致性局部特征图像结构,提高了弱纹理和复杂地区的正确匹配数量和分布。

近些年,深度学习技术的快速发展在异源图像匹配方面也取得了不错的进展。相比于传统人工设计的特征描述子只能提取和表示图像相对低层的特征,而深度学习方法能够提取更高层次、更抽象的语义特征,更接近人的视觉观察特性。依据高层次语义特征可以直接学习到图像对之间像素级别的匹配关系,能够更好地适应异源带来的非线性辐射差异影响。深度学习方法可分为单环节深度网络和端到端深度网络两种方式[46]。单环节深度神经网络仅代替部分匹配环节,因而更加灵活,可根据应用需求结合其他优势的结构构建匹配模型。如D2net[47]仅构建了提取和描述特征点为一体的匹配网络,生成一幅图像稳定的描述符向量集合;CMM-Net[40]对D2net改进用到了异源图像匹配领域,结合动态自适应欧氏距离阈值和RANSAC算法剔除误匹配点,展示了良好的效果。另外一种单环节深度网络典型案例是构建了匹配环节可以学习描述子之间可靠相似度量的网络结构,代表性方法有SuperGlue[48]网络。SuperGlue输入的可以是手工描述符也可以是CNN描述符,它从已有的局部特征中学习匹配过程,主要由注意力GNN和最优匹配层组成;注意力GNN层模拟人眼来回浏览功能,先对特征点进行编码,然后利用注意力机制来回增强匹配性能;最优匹配层计算特征向量内积得到匹配得分矩阵,最后通过Sinkhorn算法解算出最优特征分配矩阵。端到端深度网络是直接集特征提取、特征匹配、误匹配点剔除一体的网络框架,可以同时学习特征检测、特征描述符、相似性测度和粗差剔除。代表方法如LoFTR[49]先在粗粒度水平上建立逐像素的密集匹配,然后在细粒度水平上进行细化,而且借鉴了Transformer通过自注意层和交叉注意层获取两个图像的特征描述符。深度学习技术可以从数据中获取高层次语义特征,具有很强的泛化性,能有效解决较大的辐射和几何问题,但对处理设备和数据集有很严格的要求,处理流程相对复杂。

景象匹配导航技术主要面临基准图像制备存储和异源图像匹配两大难题。大范围图像需要更大的机载内存空间,且卫星图像需要一定周期才能更新,正射图像的制作也需要专业人士才能完成。虽然可以利用适配性分析技术筛选出规划路径的优质基准图像,但是景象适配性分析目前还没有特别准确地评价模型验证匹配精度和匹配概率,增加真实环境下的适配性分析实验是未来研究方向需要解决的一个问题。异源匹配环节分为大范围图像库的初始匹配和像素级的匹配定位两个方面,卫星图像和实时查询图像是两种不同图像传感器在不同时间所获得的,图像内容可能产生较大差异,对于准确匹配存在一定的难度。国内外研究学者针对这些难点也纷纷开展了相关研究,在一些应用领域也取得了显著进展。

文献[50]提出了一种无基准图的无人机图像匹配自主返航技术,在飞行任务中,无人机通过垂直摄像头分析图像光流以确定速度,并预积分数据以估算位置,同时定期保存位移和关键帧;返程时,无人机依据关键帧间位移导航至附近,并通过图像比对校正偏移,减少光流误差,直至返回起点。文献[51]提出了基于CenSurE-star的无人机景象匹配算法,先使用CenSurE-star提取特征点和FREAK描述符,然后通过汉明距离和K近邻比值匹配特征点,最后应用RANSAC模型确定几何变换,完成图像匹配并获取精确的经纬度坐标。文献[52]提出一种基于双向匹配融合的合成孔径雷达景象匹配算法,使用变形差异相似性测度进行正向匹配,并选取易匹配子区进行基于相位一致性特征的反向匹配,通过融合双向结果确定最终匹配位置,有效应对异源SAR图像差异,确保高匹配精度和鲁棒性。文献[53]提出基于加速分割检测特征(FAST)角点检测和快速视网膜关键点(FREAK)描述符的无人机景象匹配算法,改进了FAST角点检测,优化FREAK描述符,提升匹配速度;使用K近邻比值法和RANSAC进行特征匹配,建立定位模型,获取航路点与无人机的实际距离和方位。文献[54]以协方差矩阵最小特征值为匹配算法的相似性测度,提出了一种基于协方差矩阵的快速抗旋转景象匹配算法,在实时性和抗旋转方面进行仿真实验验证,并对实测图存在的噪声干扰、小范围遮挡也有一定的鲁棒性。文献[55]等利用SAR成像技术通过景象匹配修正惯导的位置累积误差,使用多普勒雷达完成高精度测速修正惯导的速度累积误差,从而用于自主导航。

文献[56]采用互信息度量对齐进行匹配定位,该方法适用于纹理丰富的城市环境,但要求卫星地图与无人机图像高度相似,不适用于异源差异大的情况。文献[57]设计了一种导航框架,该框架首先确定无人机的初始位置,随后利用光流预测技术跟踪后续帧中的特征点,通过分解单应矩阵来获取帧间的平移和旋转信息,从而推导出无人机的实时位置。此外,该框架还在UAV图像和谷歌地图间进行配准对齐,并应用粒子滤波实现从粗到精的搜索定位。文献[58]通过预绘制室内地图为无人机设定路径,利用2pt和5pt RANSAC算法处理基线问题,实现狭窄空间和动态环境下的导航。文献[59]提出使用预训练的CNN模型克服图像差异,开发了一种最小化相邻无人机帧间以及卫星地图之间误差的优化方法,实现精准匹配定位。文献[60]提出基于深度学习的定位框架,适用于非结构化环境,通过与卫星图像对齐实现定位。文献[61]提出的定位框架分为离线数据库准备和在线推理两个阶段。在第一阶段,从卫星视角渲染潜在飞行器姿态和预期飞行区域的地形图,生成彩色和深度图像,并用这些渲染图像的全局和局部描述符填充数据库;在线推理阶段,对于捕获的真实世界查询图像,系统会从数据库中检索最优全局匹配,并通过局部描述符匹配进一步精确无人机的姿态。文献[62]提出全球视觉定位方案,使用季节不变描述符匹配无人机与卫星图像,旨在解决在没有初始姿态和路径规划信息情况下的定位问题。文献[63]提出基于卫星图像的热红外图像地理定位框架,该框架融合了多域自适应方法,解决红外与卫星图像的匹配问题。文献[64]应用DenseNet,通过质量感知模板匹配和多尺度特征融合,并引入了多尺度特征层融合机制,精准定位无人机在卫星图像中的位置。文献[65]提出从粗到精的定位方法,采用分段方向统计特征、双边检索、SuperPoint网络等,达到0.1米的定位精度。文献[66]提出了一种红外与可见光的多级匹配算法,通过引入相位一致性变换增强了对噪声和形变的适应性,实现了精确匹配。文献[67]开发了一套无人机导航仿真系统,采用加权Hausdorff距离匹配算法,并结合小波分析和蚁群算法进行航迹规划与定位。文献[68]设计了一种异源图像匹配算法,通过像素层次的特征描述,实现了不同传感器间的可靠匹配。在SAR平台定位方面,文献[69]和[70]利用SAR图像与光学图的匹配,结合直线信息和高度传感器数据,实现了高精度定位。针对山区光照变化问题,文献[71]通过生成光照明暗图和山谷显著图,提高了匹配正确率和鲁棒性。文献[72]提出了一种基于景象匹配的航摄图像二维定位方法,通过任务规划、特征匹配和坐标解算,提升了定位精度和速度。为解决异源图匹配难题,文献[73]结合深度学习与模板匹配,实现了道路河流特征的准确提取与匹配。此外,文献[74]利用U-Net网络进行图像语义分割,通过建筑物信息配准克服了季节变化等因素的干扰。文献[75]和[76]则分别引入SuperGlue网络和NetVLAD框架,通过深度学习技术提升了特征点提取和图像检索匹配的准确性和效率。

无人机景象匹配导航技术旨在解决拒止环境下无人机的自主导航问题。该技术通过捕捉实时图像与基准图像进行匹配,实现绝对定位,具有自主性好、精度高、抗干扰性强等特点。近年来,虽然该技术在一些领域的应用取得了显著的研究成果,但仍需在很多方面需要改进,未来的工作要围绕以下几个方面开展。

1)算法持续优化。随着计算能力的提升,未来景象匹配算法将更加注重高效计算和稳定性,以应对各种复杂图像状况,提高匹配的准确性和实时性。2)多传感器融合。为了进一步提升导航精度和鲁棒性,未来研究将探索如何有效融合多源传感器数据,如激光雷达、红外线传感器、气压高度计等,从而提供更丰富的环境信息。

3)深度学习技术的应用。随着深度学习技术的不断发展,未来无人机景象匹配导航系统将更加依赖深度学习模型来提取图像特征、优化匹配过程,并提升系统的智能化水平。

4)跨领域合作与应用拓展。随着技术的成熟,无人机景象匹配导航技术有望在更多领域得到应用,如智慧城市、农业自动化等。同时,跨领域的合作也将推动该技术不断创新和发展。

综上所述,无人机景象匹配导航技术作为实现无人机自主导航的重要手段,其未来发展潜力巨大。通过不断优化算法、融合多源数据以及应用深度学习技术,该技术将在更多领域发挥重要作用。PG电子官方平台PG电子官方平台